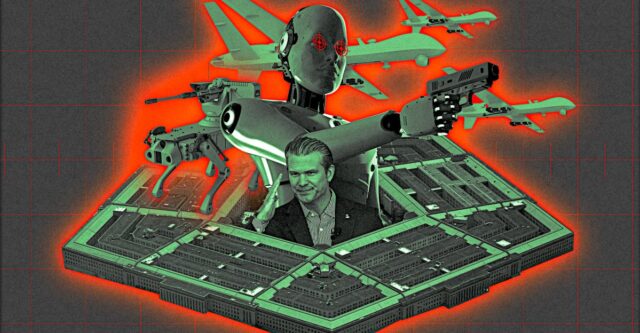

A batalha de semanas da Antrópico com o Pentágono girou em torno de postagens nas redes sociais, alertando sobre declarações públicas e citações diretas de funcionários anônimos do Pentágono à imprensa. Mas o futuro da startup de IA de US$ 380 bilhões se resume a três palavras: “Uso legal”. Nova terminologia para OpenAI e xAI supostamente O acordo já em vigor dará aos militares dos EUA o poder de utilizar os serviços de vigilância em massa, armas letais autónomas e IA com plenos poderes para localizar e matar alvos sem que os seres humanos sejam envolvidos no processo de tomada de decisão.

As negociações pioraram devido à ameaça do governo de designar a Anthropic como um “risco da cadeia de abastecimento” por causa do diretor de tecnologia do Pentágono, Emil Michael, ex-CEO da empresa de transporte Uber, de acordo com duas pessoas familiarizadas com as negociações. Esta classificação é normalmente reservada para ameaças à segurança nacional, tais como influência estrangeira maliciosa ou guerra cibernética. O CEO da Antrópico, Dario Amodei, disse: supostamente Ele se encontrou com o secretário de Defesa Pete Hegseth no Pentágono na terça-feira, mas um oficial de defesa anônimo descreveu-o como uma “reunião escrupulosa”.

É sem precedentes que o Departamento de Defesa faça tal ameaça contra uma empresa americana. Mas o Pentágono publicamente Emitir esta ameaça é ainda mais estranho.

Por razões de segurança, o Departamento de Defesa não divulga quais empresas estão nessas listas, muito menos as ameaça publicamente caso discordem. Na verdade, Jeffrey Gertz, pesquisador sênior do Centro para uma Nova Segurança Americana (CNAS), disse: A beira que De acordo com os regulamentos federais atuais O Pentágono poderia ter classificado os seres humanos como um risco sem informar o público ou explicar porquê. “Este é um passo adicional e vai além para rotulá-lo especificamente como um risco à segurança nacional e tentar impedir que outras empresas façam negócios com a Anthropic.”

O conflito é sobre a aplicação dos “Termos de Uso” da Anthropic.

Se esta classificação se tornar oficial, poria fim ao contrato de 200 milhões de dólares da Antrópico com o Departamento de Defesa, mas teria ramificações ainda mais devastadoras para os resultados globais da Antrópico. Os principais empreiteiros de defesa e empresas de tecnologia, incluindo AWS, Palantir e Anduril, usam Claude da Anthropic para seu trabalho no Departamento de Defesa. Isso se deve ao fato de Claude da Anthropic ser o primeiro modelo de IA com permissão para usar informações confidenciais. Mais claramente, se a Anthropic fosse rotulada como um “risco da cadeia de abastecimento”, as empresas que atualmente trabalham ou procuram contratos militares teriam de aposentar os sistemas de IA da Anthropic, que são considerados os melhores do setor. (Na véspera da reunião agendada entre o Sr. Amodei e o Sr. Hegseth, o Pentágono confirmou que: assinou um contrato para usar Grokum polêmico modelo de IA criado pelo xAI de Elon Musk em um sistema classificado. O Pentágono não respondeu imediatamente a um pedido de comentário. )

Isto pode ser implementado num sentido muito estrito ou num sentido muito amplo. “Acho que a explicação mais lógica é uma definição mais restrita que diz que Antrópico não pode ser usado como parte de uma descrição de trabalho específica do Departamento de Defesa”, disse Gertz. “Mas dados alguns dos relatórios e esforços para fazer com que isso pareça um movimento punitivo contra a Antrópico, vale a pena considerar ambos os cenários”.

O Pentágono e os seus aliados mediáticos travaram uma campanha para rotular a humanidade como “acordada”, mas ainda não fizeram acusações graves de vulnerabilidades de segurança ou possível espionagem. Em vez disso, o conflito é sobre a aplicação dos “termos de serviço” da Anthropic, de acordo com pessoas familiarizadas com as discussões internas.

Uma pessoa familiarizada com o assunto falou sob condição de anonimato devido ao sigilo das negociações. A beira A Anthropic tem sido muito clara com o governo sobre as linhas vermelhas que não pode ultrapassar, e há duas coisas estreitas com as quais não concorda: operações de movimento autónomas e vigilância doméstica em grande escala. A última razão é porque “a lei não acompanhou as capacidades da IA” e a IA pode infringir as liberdades civis americanas, disse o funcionário. Em relação às primeiras armas autônomas letais, a fonte disse: “A tecnologia para armas totalmente autônomas sem envolvimento humano ainda não existe”.

Hamza Chaudhry, chefe de IA e segurança nacional do Future of Life Institute, um grupo de investigação bipartidário centrado na governação da IA, observou que as linhas vermelhas da Antrópica já reflectem as actuais directivas governamentais que não foram revogadas.

“A Diretiva 3000.09 do Departamento de Defesa exige que todos os sistemas de armas autônomos sejam projetados para permitir que comandantes e operadores exerçam ‘um nível apropriado de julgamento humano no uso da força’, um princípio consagrado na Declaração Política sobre o Uso Militar de IA publicada pelo governo dos EUA e endossada por 50 países”, disse ele. A beira acima do texto. “E a Directiva 5240.01 do Departamento de Defesa, reforçada pela NDAA de 2017 e pela disposição de Vias de Implementação de IA Responsáveis da era Trump, proíbe as agências de inteligência de recolherem informações sobre pessoas americanas, excepto através de certas autoridades legais, como a FISA ou o Título 50.

“As políticas de uso aceitável da Antrópico refletem essas mesmas políticas, e até que o Departamento de Defesa abandone, esclareça ou atualize formalmente essas posições políticas, a grande questão é se o próprio governo pode forçar a empresa a abandonar as políticas com as quais se comprometeu em princípio.”

Nas negociações em nome do Pentágono está Michael, nomeado por Trump para servir como subsecretário de defesa para pesquisa e engenharia, uma posição frequentemente descrita como diretor de tecnologia do Pentágono. (primeira fonte) descreve Michael como tendo construído uma reputação positiva como diretor de negócios da Uber e anteriormente Ele se gabou para um repórter de ter investigado a oposição.como um “negociador duro”. (Michael foi forçado a sair da Uber em 2017 depois que o conselho de administração da empresa cometeu má conduta. Pesquisa de cultura corporativa O ato de assédio sexual resultou de uma visita que ele e vários executivos fizeram a um bar de acompanhantes na Coreia do Sul. )

“Esta é realmente uma questão de princípio para o emir”, disse outra pessoa familiarizada com o assunto, acrescentando que está frustrado com o facto de as empresas privadas estarem a tentar controlar o uso da tecnologia pelo governo. Não está claro se a Casa Branca ou o capitalista de risco e poderoso IA e criptoczar David Sachs aprovaram antecipadamente as táticas pesadas de Michael.

A “política de uso aceitável” da Anthropic agora faz parte do contrato de US$ 200 milhões assinado com o Departamento de Defesa em julho passado. A empresa mencionou “IA responsável” cinco vezes em seu anúncio. “No centro deste trabalho está a nossa crença de que a tecnologia mais poderosa tem a maior responsabilidade”, escrevem, observando que no contexto de governos onde “as decisões impactam milhões e os riscos não poderiam ser maiores”, a responsabilidade de garantir que “o desenvolvimento da IA fortalece os valores democráticos globalmente, mantendo a liderança tecnológica para proteger contra abusos autoritários” é “vital”.

“Esta designação exigiria que todos os empreiteiros de defesa que procuram trabalho governamental certificassem que removeram toda a tecnologia antroposófica dos seus sistemas.”

Mas em janeiro, Hegseth publica memorando O departamento anunciou que se tornaria uma “força de combate ‘primeiro a IA’ em todos os componentes” e que precisaria incorporar a linguagem de “qualquer uso legal” nos contratos de aquisição de serviços de IA no prazo de 180 dias, incluindo as orientações existentes.

No memorando de Hegseth, ele reiterou que o departamento dá prioridade à velocidade a todo custo, escrevendo que os países devem “remover os desincentivos à partilha de dados… (e) abordar compensações de risco, ‘equidade’ e outras questões subjectivas como se estivéssemos em guerra”. Ele também disse que o departamento integrará o desenvolvimento e teste de agentes de IA “desde o planejamento da campanha até a execução da cadeia de destruição” e “transformará informações em armas em horas”.

Hegseth priorizou repetidamente a velocidade em detrimento da segurança e do potencial de erro, e “deve aceitar que os riscos de não se mover rápido o suficiente superam os riscos de uma coordenação imperfeita”. Ele enfatizou ainda mais posteriormente no memorando, escrevendo que a “IA responsável” veria grandes mudanças no setor no campo de batalha e nas fileiras militares. “Diversidade, equidade, inclusão e ideologia social não têm lugar no DoW”, escreveu ele, acrescentando que o departamento “deve também aproveitar modelos livres de restrições políticas de utilização que possam limitar aplicações militares legítimas”. Semelhante à anti-“IA acordada” do presidente Trump ordem presidencialHegseth anunciou que o benchmarking de objetividade do modelo se tornará o novo critério chave de aquisição para serviços de IA.

OpenAI, xAI e Google renegociaram imediatamente seu contrato de US$ 200 milhões com o Departamento de Defesa, de acordo com o memorando de Hegseth. No entanto, nenhum dos modelos dessas empresas possui classificação de segurança de Nível de Impacto 6. Isso significa que se Anthropic estiver na lista negra, ChatGPT, Grok e Gemini não poderão substituir Claude imediatamente. Esta é uma vulnerabilidade de fornecedor único que sai pela culatra para o Departamento de Defesa.

“Claude é o único modelo Frontier AI em execução em uma rede totalmente classificada do Departamento de Defesa, implantada por meio da plataforma AI da Palantir e da nuvem secreta da Amazon, o que significa que está no centro de um fluxo de trabalho ao qual poucos outros modelos ainda têm acesso”, disse Chaudhry. “Esta designação exigiria que todos os empreiteiros de defesa que procuram trabalho governamental certificassem que removeram toda a tecnologia antroposófica dos seus sistemas.”

Isto deu à Antrópica vantagem no conflito com o Pentágono, que supostamente aumentou ainda mais depois que a empresa soube que: Esse modelo foi usado para prender o presidente venezuelano Nicolás Maduroem violação do contrato atual.

A Anthropic é tecnicamente incapaz de coordenar ou se unir a outros laboratórios de IA que recebem novos termos, mesmo que concordem com eles, pois isso violaria os regulamentos federais de aquisição. Mas à medida que esta batalha é travada em público, os trabalhadores da tecnologia, os funcionários da IA e outros que trabalharam atualmente ou anteriormente na indústria tecnológica estão a expressar frustração pelo facto de outras empresas não estarem a lutar nos mesmos termos que a Anthropic. Outros pareciam pensar que era apenas uma questão de tempo até que a humanidade sucumbisse.

“Seria um momento muito bom para[outros laboratórios]pensarem: ‘Espere um minuto, o que você está fazendo com a nossa tecnologia?'”, disse William Fitzgerald, ex-funcionário do Google que agora dirige uma empresa de defesa chamada The Worker Agency. “As pessoas nesses laboratórios de IA têm muito poder. Eles são uma equipe pequena e ainda estão moldando quem serão… Acho que eles podem justificar sua reputação sem fazer trabalho militar. Existem outras maneiras de administrar um negócio sem matar pessoas em seu modelo de negócios.”