A OpenAI celebrou um acordo com o Pentágono para desenvolver modelos de inteligência artificial em sistemas militares classificados, poucas horas depois de o presidente Donald Trump ordenar às agências federais que parassem de usar tecnologia anti-humana.

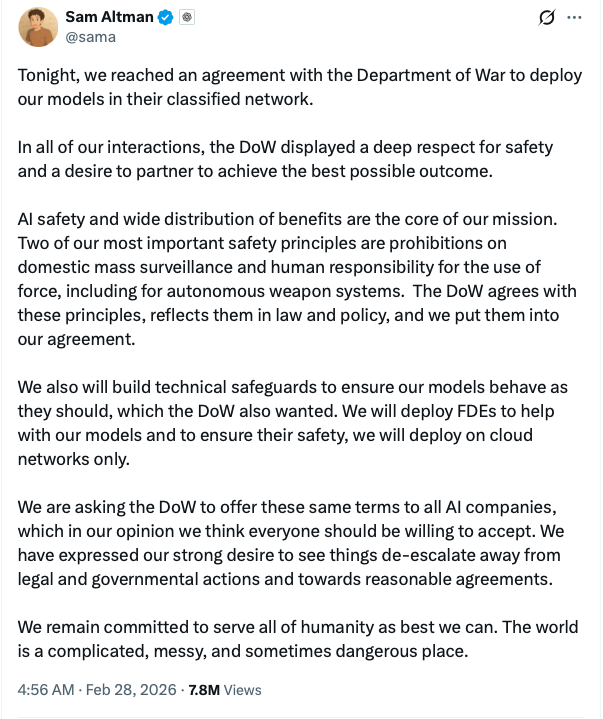

O anúncio foi feito na sexta-feira pelo CEO da OpenAI, Sam Altman, que disse que a empresa tem um acordo com o Departamento de Defesa para usar seus modelos em redes confidenciais. O acordo segue-se a uma forte escalada entre a administração Trump e a Antropologia sobre como os sistemas de IA podem ser usados em contextos militares.

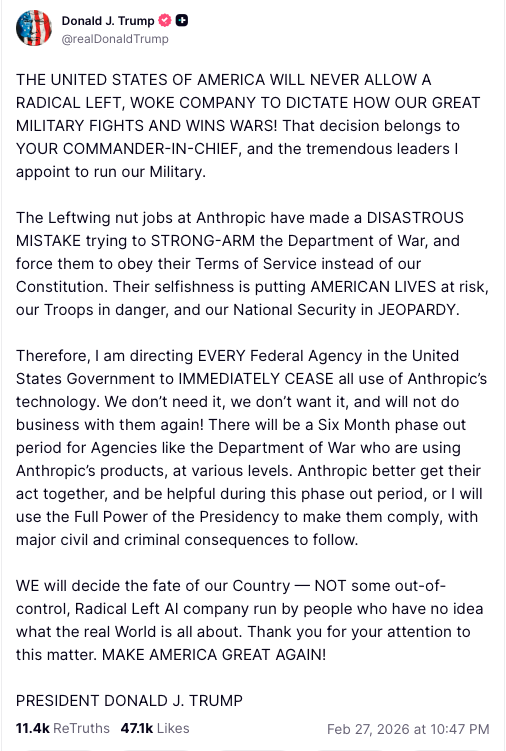

No início do dia, Trump instruiu todas as agências federais a “eles deveriam parar de uma vez“O uso de produtos artificiais. O secretário de Defesa Pete Hegseth também se juntou à empresa.”risco da cadeia de abastecimento para a segurança nacional”Uma classificação normalmente usada pelas autoridades de agências federais para restringir certas tecnologias em contratos de defesa.

Restrições semelhantes à cadeia de fornecimento foram aplicadas nos últimos anos a empresas de telecomunicações estrangeiras, como Huawei e ZTE. Seção 889 da Lei de Autorização de Defesa Nacional de 2019. Essas medidas são utilizadas por uma agência federal para certificar os empreiteiros de que tecnologias proibidas não são utilizadas em contratos governamentais. No caso de um design antropogénico, exige que o Pentágono desenvolva a utilização do sistema da empresa e obriga os fornecedores militares a certificarem que o seu trabalho de Defesa não envolve ferramentas antropogénicas de IA. A administração forneceu uma janela de transição de seis meses.

Espaço TNW City Coworking – onde o melhor trabalho é feito

Um espaço de trabalho para crescimento, colaboração e oportunidades infinitas de networking no coração da tecnologia.

O exercício centra-se em saber se a equipe de IA pode limitar a forma como os militares usam seus sistemas.

A Anthropica procurou garantias contratuais de que o modelo emblemático não seria utilizado para o cerco doméstico em massa de americanos ou para fornecer energia a armas totalmente autónomas. O Pentágono disse que não pretende usar a IA desta forma, mas que deveria estar disponível para todos os modelos legítimos.

Após semanas de negociações, as negociações entre a Anthropic e o Departamento de Defesa foram interrompidas. As autoridades acusaram a empresa de tentar impor restrições ideológicas às operações militares. A Anthropica afirmou que suas objeções eram restritas e visavam à saúde e aos direitos constitucionais.

Pouco depois da ação do governo contra a Anthropic, Altman anunciou que a OpenAI havia concluído seu acordo com o Pentágono.

Em um após 10 dias *Altman disse que o acordo reflete o compromisso dos dois com a OpenAI.princípios especialmente segurança”: proibições relativas à vigilância doméstica em massa e à exigência de responsabilidade humana no uso da força, incluindo sistemas de armas autônomos.

“O DoW concorda com estas razões, as da lei e da política, e nós as colocamos de acordo;Altman escreveu, referindo-se à recente contratação do departamento.Departamento de Guerra“Notando em uma postagem pública.

Não está claro como o consenso da OpenAI diferirá em substância das salvaguardas antropogénicas procuradas. Funcionários do Pentágono argumentaram que a lei dos EUA e a política do Departamento de Defesa já proíbem os tiroteios em massa domésticos e que as armas são totalmente autónomas e que novas normas legais não são necessárias.

A polêmica com a antropologia tornou-se cada vez mais política nos últimos dias.

Em um Postagem de verdade socialTrumpet criticou a empresa em termos duros e estabeleceu a sua posição como uma tentativa de destruir a autoridade da constituição. Hegseth acusou a Anthropic de tentar exercer controle sobre as decisões operacionais militares e disse que o departamento deveria manter o acesso aos modelos de IA gratuito para fins legítimos.

A Anthropica recuou, argumentando que o risco do projeto da cadeia de suprimentos excedia a autoridade estatutária da Defesa. A empresa disse que a lei federal limita tais determinações a contratos específicos relacionados à defesa e não dá ao poder executivo ampla autoridade para impedir qualquer atividade comercial com uma empresa nacional. A Antrópico disse que pretende contestar a designação na Justiça.

As determinações de risco da cadeia de abastecimento estão mais frequentemente associadas a empresas estrangeiras consideradas ameaças à segurança nacional. A aplicação da designação a criadores de IA baseados nos EUA marca uma mudança significativa na forma como as autoridades das agências são utilizadas no contexto da inteligência artificial.

A realidade é a rapidez com que a IA se tornou parte da política de segurança nacional.

Os acordos xAI da OpenAI, Anthropic, Google e Elon Musk ou aprovações do Departamento de Defesa para o uso de seus modelos de IA são indicados no escopo. Ao mesmo tempo, foram recomendadas preocupações sobre vigilância, armas autónomas e modelos de linguagem em grande escala, e o escrutínio das iniciativas militares de IA tem sido centrado.

A Anthropica, que a NPR informou estar avaliada em quase US$ 380 bilhões e está se preparando para uma oferta pública, agora enfrenta incerteza jurídica e de reputação com base em ações de gestão. O contrato do Pentágono que está no centro da controvérsia vale até 200 milhões de dólares, uma parcela relativamente pequena da receita reportada da empresa, mas simbolicamente significativa.

Para a OpenAI, o acordo posiciona a empresa como um parceiro-chave na estratégia de IA do Departamento de Defesa, ao mesmo tempo que mantém os seus princípios de segurança declarados publicamente.

Ainda não está claro se os resultados contrastantes refletem diferenças substanciais nos termos contratuais ou estratégias de negociação divergentes. O que está claro é que a relação entre os criadores de IA e os militares dos EUA entrou numa fase mais visível e política.