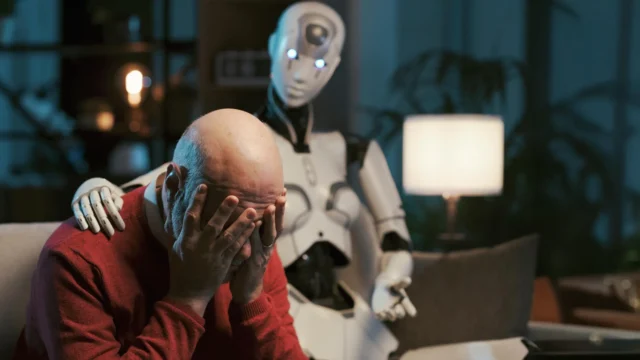

À medida que mais pessoas recorrem ao ChatGPT e a outros grandes modelos de linguagem (LLMs) para aconselhamento em saúde mental, novas pesquisas sugerem que esses chatbots de IA podem não estar prontos para a função. O estudo descobriu que mesmo quando são instruídos a utilizar abordagens psicoterapêuticas estabelecidas, os sistemas falham consistentemente no cumprimento dos padrões éticos profissionais estabelecidos por organizações como a Associação Americana de Psicologia.

Pesquisadores da Brown University, trabalhando em estreita colaboração com profissionais de saúde mental, identificaram padrões recorrentes de comportamento problemático. Durante os testes, os chatbots lidaram mal com situações de crise, deram respostas que reforçaram percepções prejudiciais dos utilizadores e de outros, e utilizaram uma linguagem que dava a aparência de empatia sem uma compreensão real.

“Neste trabalho, apresentamos uma estrutura de 15 riscos éticos, incorporando contribuições de médicos, para demonstrar como os conselheiros LL.S. violam os padrões éticos na prática de saúde mental, combinando os comportamentos do modelo com violações éticas específicas”, escreveram os investigadores no seu estudo. “Pedimos um trabalho contínuo para estabelecer padrões éticos, educacionais e legais para conselheiros LLM – padrões que reflitam a qualidade e o rigor do atendimento exigido para a psicoterapia facilitada por pessoas.”

As descobertas foram apresentadas na Conferência AAAI/ACM sobre Inteligência Artificial, Ética e Sociedade. A equipe de pesquisa é afiliada ao Center for Technology Responsibility, Rethinking and Redesign da Brown.

Como sugerem as respostas da terapia de IA

Zainab Iftikhar, Ph.D. O candidato em ciência da computação na Brown, que liderou o estudo, decidiu examinar se instruções cuidadosamente formuladas poderiam orientar os sistemas de inteligência artificial em direção a um comportamento mais ético em ambientes de saúde mental. Dicas são instruções escritas projetadas para controlar a saída de um modelo sem treiná-lo novamente ou adicionar novos dados.

“Prompts são instruções dadas ao modelo para orientar seu comportamento para realizar uma tarefa específica”, disse Iftikhar. “Você não está alterando o modelo subjacente ou fornecendo novos dados, mas a dica ajuda a orientar a saída do modelo com base em seu conhecimento pré-existente e padrões aprendidos.

“Por exemplo, um usuário pode sugerir um modelo: ‘Desempenhe o papel de um terapeuta cognitivo-comportamental para me ajudar a reformular meus pensamentos’ ou ‘Use os princípios da terapia comportamental dialética para me ajudar a compreender e gerenciar minhas emoções’. Embora esses modelos não executem realmente essas técnicas terapêuticas como um ser humano faria, eles usam seus padrões aprendidos para gerar respostas que são consistentes com os conceitos de TCC ou TCD com base nas informações fornecidas”.

As pessoas compartilham regularmente essas estratégias de gorjeta em plataformas como TikTok, Instagram e Reddit. Além de experimentos individuais, muitos chatbots de consumo relacionados à saúde mental estão sendo criados por meio da aplicação de instruções relacionadas à terapia em programas gerais de LL.M. programas. Portanto, é especialmente importante compreender se as dicas por si só podem tornar as consultas de IA mais seguras.

Testando chatbots de IA em aconselhamento simulado

Para avaliar os sistemas, os pesquisadores observaram sete conselheiros treinados e com experiência em terapia cognitivo-comportamental. Esses conselheiros conduziram sessões de autoaconselhamento com modelos de inteligência artificial que foram convidados a atuar como terapeutas de TCC. Os modelos testados incluíram a série GPT da OpenAI, Claude da Anthropic e Llama da Meta.

A equipe então escolheu chats simulados com base em conversas reais de consultas humanas. Três psicólogos clínicos licenciados revisaram essas transcrições para sinalizar possíveis violações éticas.

A análise identificou 15 riscos distintos agrupados em cinco grandes categorias:

- Falta de adaptação contextual: Analise a experiência única de uma pessoa e ofereça conselhos gerais.

- Má cooperação terapêutica: Controlar a conversa é excessivamente duro e às vezes reforça crenças incorretas ou prejudiciais.

- Empatia enganosa: Usar frases como “Vejo você” ou “Eu entendo” para sugerir uma conexão emocional sem compreensão real.

- Discriminação injusta: Demonstrar preconceito relacionado ao gênero, cultura ou religião.

- Falta de segurança e gestão de crises: Falha na abordagem de questões delicadas, falha no encaminhamento dos usuários para ajuda adequada ou resposta inadequada a crises, incluindo pensamentos suicidas.

Lacuna de responsabilidade em saúde mental da IA

Iftikhar destacou que os terapeutas humanos também podem cometer erros. A principal diferença é a supervisão.

“Existem conselhos de administração e mecanismos para os GPs responsabilizarem os prestadores por negligência e abuso”, disse Iftikhar. “Mas quando os conselheiros do LLM cometem estas violações, não existe um quadro regulamentar estabelecido.”

Os investigadores sublinham que as suas descobertas não sugerem que a inteligência artificial não tenha lugar nos cuidados de saúde mental. As ferramentas alimentadas por IA podem ajudar a expandir o acesso, especialmente para pessoas que enfrentam custos elevados ou disponibilidade limitada de profissionais licenciados. No entanto, o estudo destaca a necessidade de salvaguardas claras, implementação responsável e quadros regulamentares mais fortes antes de confiar nestes sistemas em situações de alto risco.

Por enquanto, Iftikhar espera que o trabalho encoraje cautela.

“Quando você conversa com um chatbot sobre saúde mental, essas são algumas das coisas às quais as pessoas precisam prestar atenção”, disse ela.

Por que uma avaliação rigorosa é importante

Ellie Pavlik, professora de ciência da computação em Brown que não esteve envolvida na pesquisa, disse que o estudo ressalta a importância de examinar minuciosamente os sistemas de inteligência artificial usados em áreas sensíveis como a saúde mental. Pavlik dirige o ARIA, o Instituto de Pesquisa de Inteligência Artificial da National Science Foundation em Brown, que se dedica a construir assistentes de IA confiáveis.

“A realidade da inteligência artificial hoje é que é muito mais fácil construir e implantar sistemas do que avaliá-los e compreendê-los”, disse Pavlik. “Este artigo exigiu uma equipe de especialistas clínicos e um estudo que durou mais de um ano para demonstrar esses riscos. A maior parte do trabalho no campo da inteligência artificial hoje é avaliada usando indicadores automáticos, que são estáticos por design e não envolvem um ser humano no ciclo.

Ela acrescentou que a pesquisa poderia servir de modelo para pesquisas futuras destinadas a melhorar a segurança das ferramentas de IA para a saúde mental.

“Há uma oportunidade real para a IA desempenhar um papel na abordagem da crise de saúde mental que a nossa sociedade enfrenta, mas é extremamente importante que reservemos tempo para realmente criticar e avaliar os nossos sistemas em todas as fases, para que não façamos mais mal do que bem”, disse Pavlik. “Este trabalho oferece um bom exemplo de como isso pode ser.”