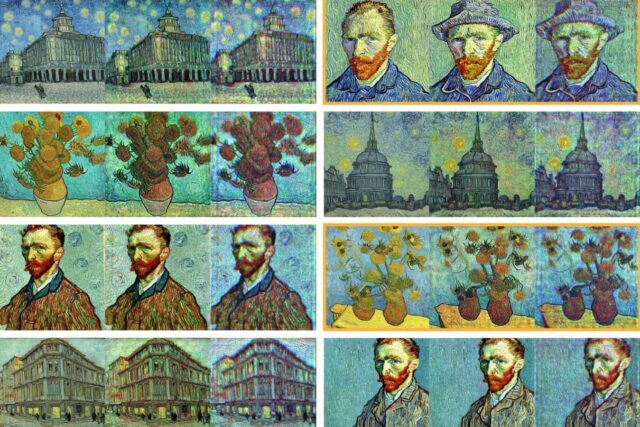

Arte colorida no estilo Vincent van Gogh produzida por modelos de difusão tradicionais (à esquerda em cada conjunto de três) e um gerador de imagem óptica (à direita)

Shiqi Chen et al. 2025

Os geradores de imagens de IA que usam luz para gerar imagens em vez do hardware de computação tradicional têm o potencial de reduzir o consumo de energia centenas de vezes.

Quando os modelos de inteligência artificial geram imagens a partir de texto, eles normalmente usam um processo chamado difusão. A IA é primeiro apresentada a uma grande coleção de imagens, mostra como interromper as imagens usando ruído estatístico e, em seguida, codifica esses padrões em um conjunto de regras. Dada uma nova imagem com ruído, podemos utilizar estas regras para fazer a mesma coisa ao contrário. Ou seja, são necessárias muitas etapas para trabalhar em direção a uma imagem consistente que corresponda à solicitação de texto fornecida.

Para imagens realistas e de alta resolução, a difusão utiliza muitas etapas consecutivas e requer um nível significativo de poder computacional. Em abril, Relatado por OpenAI Um novo gerador de imagens anunciou que criou mais de 700 milhões de imagens em sua primeira semana de operação. Atender demandas dessa escala requer enormes quantidades de energia e água para alimentar e resfriar as máquinas que operam os modelos.

agora, Idogan Ozkan da Universidade da Califórnia, em Los Angeles, e colegas desenvolveram um dispositivo de geração de imagens baseado em difusão que funciona usando feixes de luz. Embora o processo de codificação seja digital e exija uma pequena quantidade de energia, o processo de decodificação é totalmente baseado em luz e não requer poder de computação.

“Ao contrário dos modelos de difusão digital que requerem centenas a milhares de etapas iterativas, este processo consegue a geração de imagens em instantâneos e não requer cálculos adicionais além da codificação inicial”, diz Ozcan.

O sistema primeiro usa um codificador digital treinado com conjuntos de dados de imagens disponíveis publicamente. Este codificador pode gerar dados estáticos que podem ser convertidos em imagens. Este codificador foi então usado com uma tela de cristal líquido chamada modulador de luz espacial (SLM) para imprimir fisicamente essa eletricidade estática em um feixe de laser. Quando o feixe de laser passa pelo segundo SLM de decodificação, ele produz instantaneamente a imagem desejada na tela gravada pela câmera.

Ozcan e sua equipe usaram seu sistema para criar imagens em preto e branco de objetos simples, como os números de 1 a 9 e roupas básicas, usadas para testar modelos de difusão, bem como imagens coloridas no estilo de Vincent van Gogh. Os resultados pareciam quase semelhantes aos produzidos pelos geradores de imagens tradicionais.

“Este é provavelmente o primeiro exemplo em que as redes neurais ópticas não são apenas um brinquedo de laboratório, mas uma ferramenta computacional que pode produzir resultados de valor prático”, diz ele. Alexandre Levovsky na Universidade de Oxford.

Para a foto tipo Van Gogh, o sistema consumiu apenas alguns milijoules por imagem, principalmente devido à tela LCD, em comparação com as centenas ou milhares de joules de energia exigidos pelos modelos de difusão tradicionais. “Para colocar isso em perspectiva, este último equivale à quantidade de eletricidade que uma chaleira elétrica consome em um segundo, enquanto o consumo de uma máquina óptica equivale a um milionésimo de segundo”, diz Rybovsky.

O sistema precisaria ser adaptado para funcionar em data centers, em vez de ferramentas de geração de imagens amplamente utilizadas, mas seus baixos requisitos de energia significam que ele poderia encontrar aplicações em eletrônicos vestíveis, como óculos de IA, disse Ozkan.

tópico: